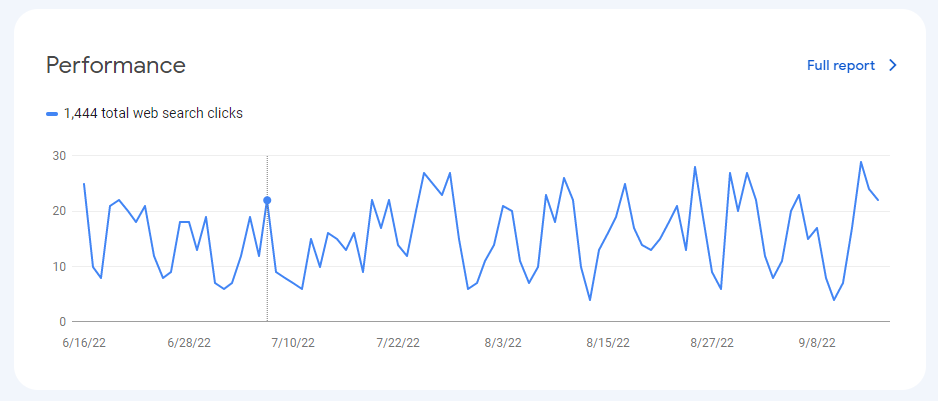

之前也说过,打算抽时间把网站的数据监控体系完善起来。

逻辑就是使用官方的 Google Search Console API,将数据定时同步到谷歌表格,同时使用谷歌脚本做好数据清洗与数据可视。

这套逻辑实现起来不难,但现在的问题是梳理清楚具体的需求是什么样的。

毕竟有几个不同的数据源,且当你需要监控的网站数据多起来之后,整套体系的运转就会复杂那么一点点了。

所以我这周有专门抽时间看不同网站的数据,一是记录下我需要重点关注的一些指标,二是看看这些工具里面提供的报表功能能否在谷歌表格里实现出来。

我期望实现的效果,就是每天邮箱里能收到各个网站前一日的数据反馈,每周每月这样的时间节点,能收到基于过往数据的对比分析。

不再需要我一个一个跟踪,所有数据能自动呈现在我面前,这样也能及时发现问题。

谈到网站出现的问题,这周也是在检查这些数据时发现,好几个今年年初刚上线的网站,其收录数据非常糟糕。

预计可能的原因,之前文章中也有谈过,无非是权重低或者内容权威不够。

也没什么好的解决办法,这条路不通了只能是换条路继续,实在不济做不起来就只能放弃了。

自然流量就是这样的,需要自己亲自去调研亲自去测试。

可能有的关键词在数据分析工具里显示很简单,但是实际上线之后困难重重。

也可能有的关键词在数据分析工具里显示很困难,但是实际上线之后流量自然而然就进来了。

我自己实际体验过好几次这种情况,反正我已经对分析工具里面的数据祛魅了,这类没经过自己亲自验证的数据就仅供参考而已。

另外当管理的网站多起来之后,是能通过这种不同关键词之间的生产环境数据对比,看出一点点其中的端倪。

比如当在生产环境中,发现一个关键词的表现很好时,完全可以沿着这个关键词的方向深入,即专门为这类垂直关键词上线站点,大概率能做起来,且最后的效果不会很差。

可能这也是我为什么今年迫切想把网站运营数据监控起来的缘故之一吧。

这一周,我是有陆续通过数据反馈买了十几个这类关键词域名,已经上线了一半左右。

也都是流水线 SOP 作业,网站的搭建与技术优化没什么难度,可能稍微复杂点的就是不同网站的内容布局需要研究,得做出不同网站之间的差异。

继续观察自然搜索的数据反馈,得根据具体数据来决定下一步的动作。

这一周做的事情其实就这么多,没什么新意没什么突破,倒是发现很多问题需要优化,都记录在待办事项里一个一个处理了。

做运营就是这样,需要根据生产环境里的实际需求,不断调整自己的方法或者流程,甚至是改变自己的策略。

但做这些具体操作的前提是得有实际运营数据的支持。