简单聊聊这周在做的事情。

之前也分享过,我今年新搭建的这些网站,最近这段时间的收录数据都不怎么样,内容上传上去之后基本都是「已抓取未收录」。

叠加这次三月垃圾内容算法更新,想着还是先暂停这部分内容更新操作。

而且这段时间,我发现有几个老站点的询盘转化非常非常差,相较于往年的数据,今年同期基本算是膝盖斩了。

简单看了下数据统计,整体的访客数并没有什么波动,但实际转化就是不行。

期间也有与一些朋友交流,发现有两个小伙伴也出现了类似转化率急跌的情况。

所以我现在的想法就是先暂停手头的工作,临时调整下工作重点,先去搞明白网站到底发生了什么,以便后面好有的放矢采取相应的应对策略。

现在的数据统计想法就很简单,直接利用这个契机将整个运营环节中的数据统计环节优化下。

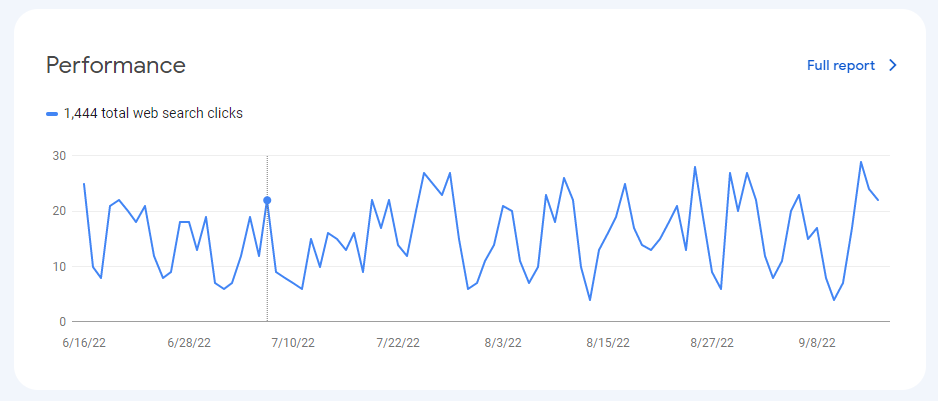

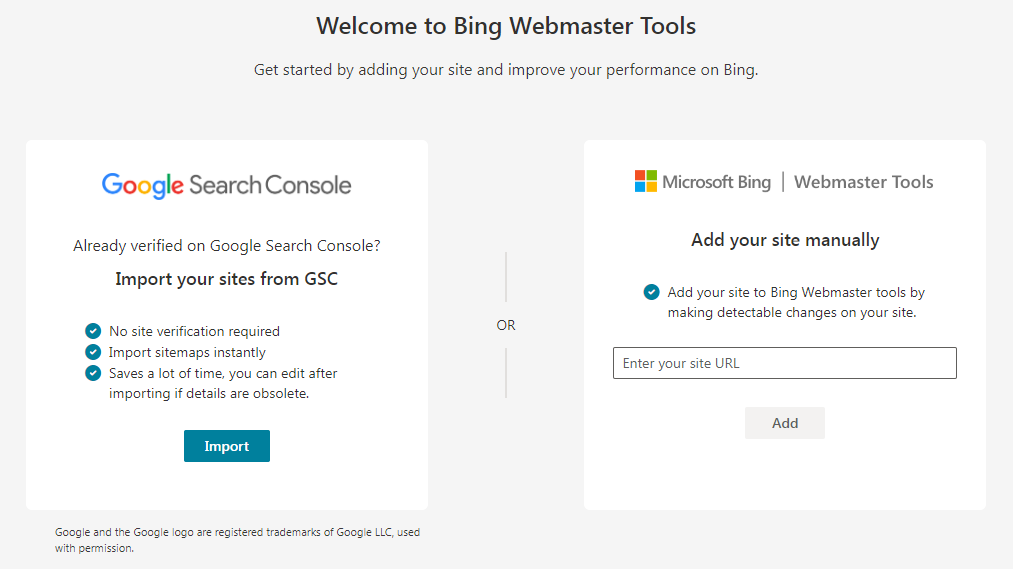

利用谷歌开发出来的数据接口,将站长工具与谷歌分析里面的数据同步出来,然后再利用脚本程序去做数据整理与数据的呈现。

这套技术流程我之前是有大体了解过的,但一直没有实操,所以这周在实际操作之前就去找了不少开源项目。

我发现目前是有不少优秀项目在完全依赖 AI 做这件事,网站各个维度的数据同步过来之后,后续就全部交给 AI 去做,包括数据的清洗与数据的呈现。

我觉得这套逻辑没什么问题,于是这周便跟着这些开源项目的指引,一并实操了相应 AI 工作流的开发。

真别说,除了 Token 消耗得快了点外,还真的没有任何缺点。

就拿一个最简单的关键词表现跟踪举例。

传统的脚本模式下,我们需要先把源数据全部保存下来,然后再根据数据结构来开发相应的脚本。

过程中需要先读取数据,然后清洗数据,最后才做数据呈现。

但是 AI 这个角色加进来之后,逻辑完全变了。

源数据保存下来之后,直接交给 AI 就好了,再也不需要人工去设计什么数据结构,或者数据呈现方式。

想要某个关键词的数据,直接大白话跟 AI 说就好了啊。

当然如果整个交互过程想做的更精细化些,比较好的一个办法还是开发相应的 SKILL,并把一些固定的数据清洗、数据加工呈现的逻辑以脚本的形式固定下来,再交给 AI 去执行。

设计好这些内容之后,放在固定的项目路径下便可以,因为 AI 知道什么时候执行,也知道执行哪些。

这套模式我也是这周才真正开始实操起来的,目前操作下来感觉总体难度并不大(可能是我还没有进到深水区)。

不管怎样吧,我已经不是程序员且我的工作也不是写代码,所以也必要去深究技术实现。

反正我自己的目标很明确,用这套 AI 模式开发出能提高工作效率的流程便可以了,至于优化就需要在实际工作中不断迭代了。

好在开源世界有不少优秀分享可以直接拿来使用,倒是很大程度上节省了时间与精力。