上个月 Grok 平台开放了它的定时任务功能,于是我花了点时间去设计了一套信息聚合的流程。

逻辑非常简单,就是每天定时将推上有关内容营销、付费投放等在线营销领域内的热门帖子梳理下来,然后提炼出大致的信息要点后发送给我。

至于推文是否热门的判断标准,我做得比较单一,就是看帖子的点赞数量与收藏数量。

而当时想做这套流程的原因,就是单纯觉得每天花时间在一堆内容里找自己想要的那几篇内容,着实有点浪费精力。

且那种垃圾信息看多了之后,慢慢让自己有点不愿继续刷下去,甚至对“刷信息”这件事都产生了厌恶。

这套流程做完之后,获取推上的信息确实高效了不少,每天也只需要花时间去学习下那些优质帖子里的内容便可以了。

所以做完这一套流程设计之后,我就一直在搜索有没有类似的办法去总结 Reddit 上的热门帖子内容,毕竟这也是我获取信息的主流渠道之一。

当时也尝试使用 Grok 的定时任务去做,但是效果一直不理想,获取到的信息都比较浅,且有时候内容组织得很乱,我猜可能原因是 Reddit 平台拒绝了 Grok 的爬虫吧。

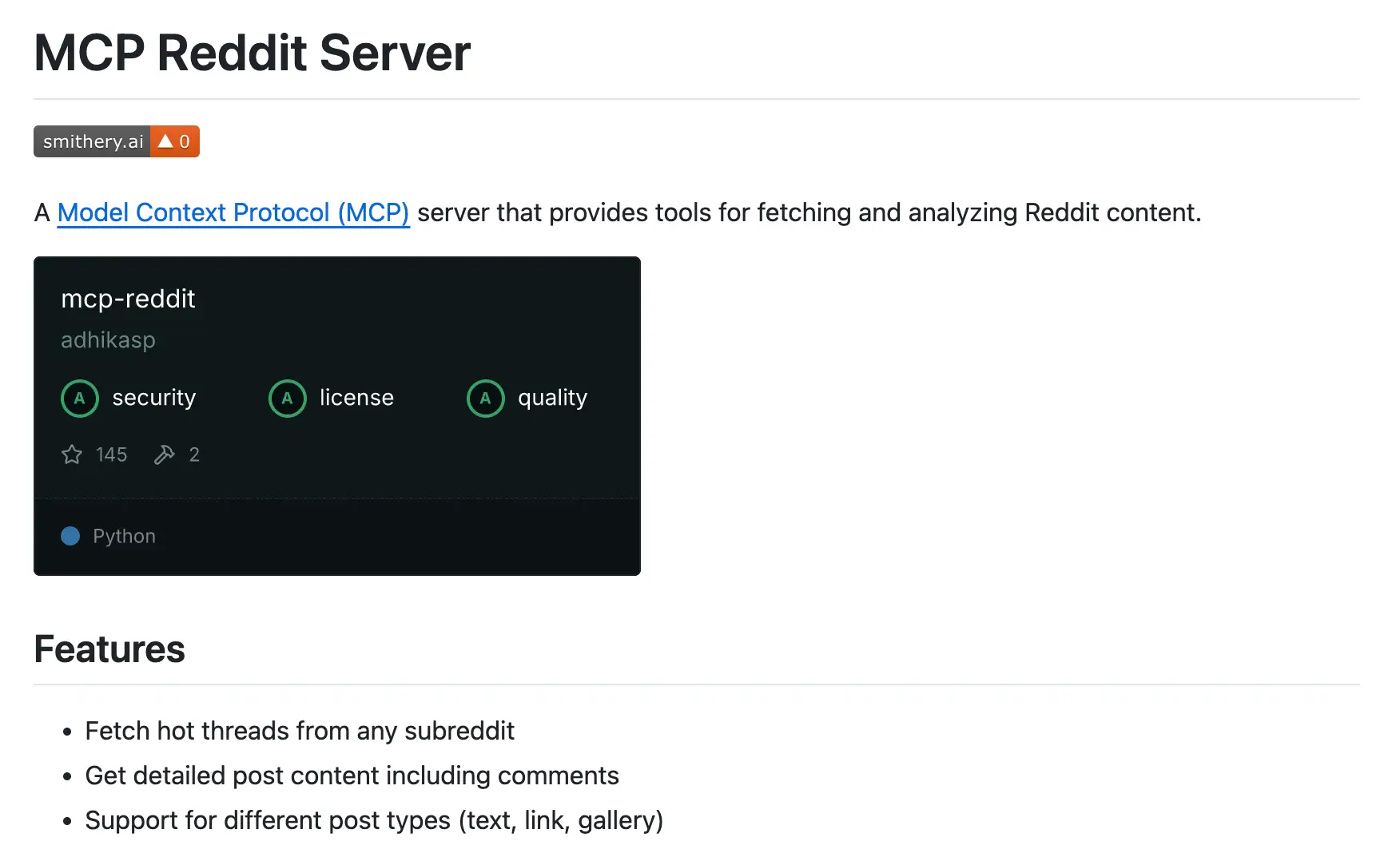

于是我最近一直在 GitHub 上找解决方案,幸运的是发现了下面这个项目。

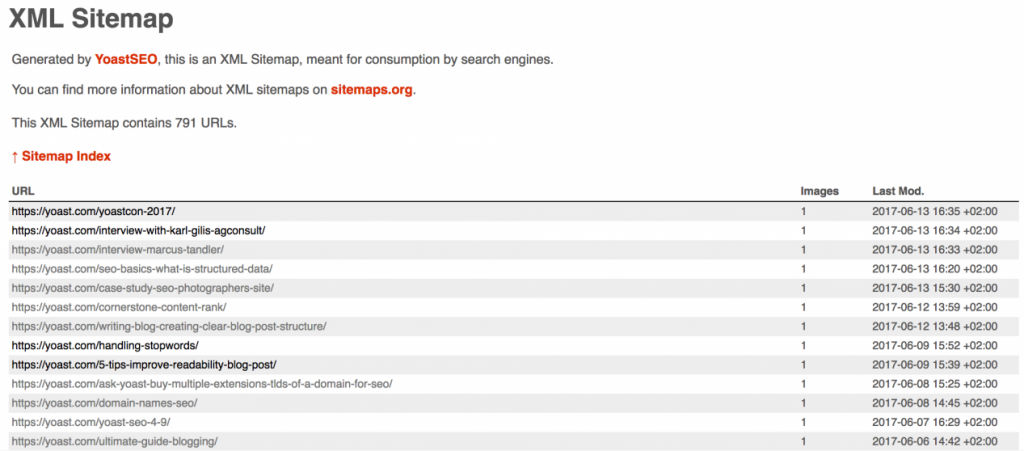

这个工具支持获取任意 subreddit 的热门帖子的完整内容和评论,并且还支持文字处理与图片处理。

看项目的官方介绍,这款工具可以与 Claude Desktop 等 MCP 客户端无缝集成,简单一键安装之后便可以使用。

但 MCP 这块我自己一直没有折腾,也不是很明白该怎么使用。打算这周利用闲暇时间专门去学习一下,看看这套标准到底是什么。

那参考这样的例子,我觉得很多平台都是可以参考这套逻辑去开发出这样一套实用信息的梳理流程出来。

技术实现上其实并不复杂,而一旦能做出来我觉得其价值还是很大的,因为这套流程能帮人节省大量时间。

那基于此能不能开发出一个产品出来,就得看需求调研的实际情况了。

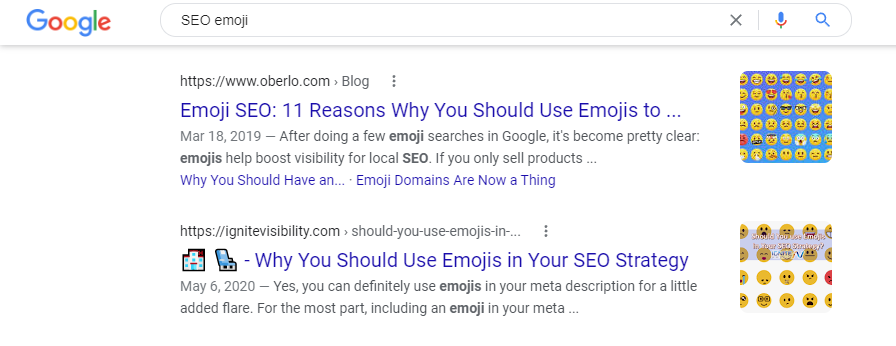

另外还有一个方向我自己觉得不错,就是基于这种已经梳理出来的优质信息来做内容站点。

像上面这种长尾关键词就是一个不错的方向,那继续沿着个方向拓展,我们可以在此基础上发展出更多的长尾关键词。

比如将这个关键词往“领域”方向拓展,可以衍生出类似“10 个关于经济方面最后价值的 Reddit 帖子”;将这个关键词往“时间”方向拓展,可以衍生出类似“25 年 7 月份最后价值的 Reddit 帖子”。

类似这样的思路还有很多,得好好调研一下。