今天有朋友跟我沟通一个问题,就是链接上线之后搜索引擎根本不收录他网站的内容。

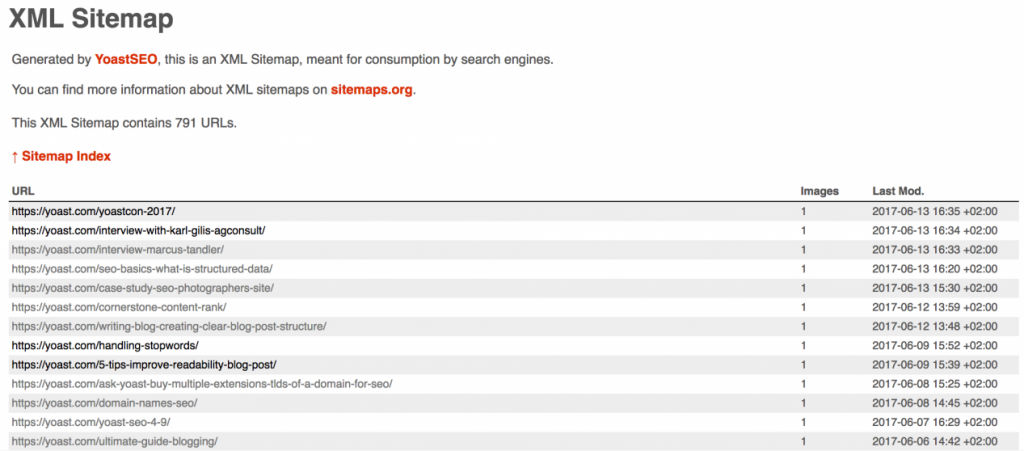

这个过程中做了很多尝试,检查了网站在技术端的一些基础设置没发现问题,主动提交网站链接到谷歌站长后台请求收录也没有下文,甚至花钱在别人的网站上买了一些外链最后发现对收录也没有效果。

反正就是在自己能力范围内能做的事情都做了,但都没有任何效果,依旧是链接不收录,在站长后台显示是“已发现-未收录”。

这个案例让我想起前段时间在英文圈看到的一篇招聘帖子,大致内容是让面试对象去搞定一个网站十万个页面的搜索引擎收录(保证收录)。

我看底下的评论都是清一色的“No way”,获赞较多的一条回复的大意是如果搜索引擎认为你的内容有价值,那搜索引擎就会收录。那反之不收录,基本就表明搜索引擎不认可你的内容,或者内容在某些方面有瑕疵。

最近我自己也有一个非常明确的体感,就是从这几个月算法陆陆续续更新之后,上线链接的收录索引与出词变得越来越难、也越来越慢了。

去年这个时候虽然算法也在更新,但收录这块基本的问题不大,关键词的出词效率也没什么太大的问题。顶多就是后面发现页面质量不行时,再去批量将已经收录的页面删除掉,属于是一种事后惩戒。

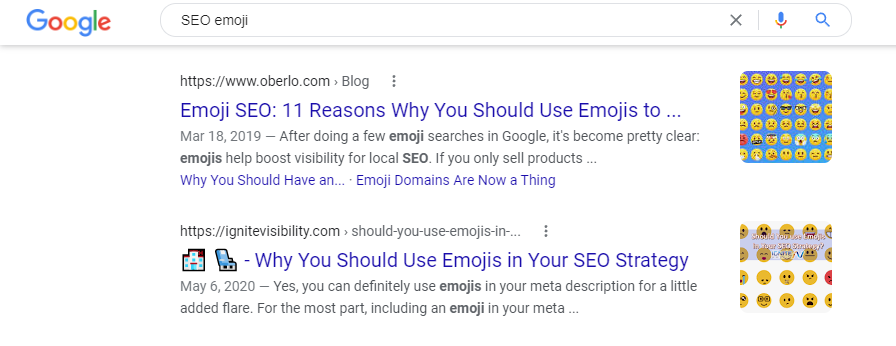

但现在的状况有点反过来,在一开始收录的时候就严卡内容质量。甚至你用 site 命令去查询链接收录数据时,在搜索引擎前台看到的数据,与站长工具后台看到的数据都完全不一样。

过往也存在这种前后端数据不一致的情况,可能原因是数据延时。但我自己今年上线的好几个新站点,这种数据不一致的情况已经持续了很长时间,可能也是系统有意为之吧,这就没办法搞清楚原因了。

所以对于现在这种内容做好了但是不收录的情况,我们真的没办法啊。即便你在原有内容的基础上做内容更新,短期内也不好使。

但内容运营又是一件需要长期坚持的事情,即便现在不收录,也最好不要自暴自弃放弃了自己的运营进度。所以继续按照自己的节奏做了,注意内容版面与内容质量,甚至可以的话分一点精力去做社媒的营销与寄生营销。

其实目前这种情况最不利的是程序化站点的运营,因为采用的都是一套页面样板,然后使用数据去直接渲染页面的。

而且一旦你的链接数量上线的太快,又会招致算法的直接惩罚。所以现在也只能是放慢速度,一点点逐步去更新自己的内容了。

我不清楚这种情况是不是跟我的网站权重相关的,因为我现在都是在新站点上做的这些测试。相反老站点因为已经成熟了,也不敢再在上面做批量内容更新了。

另外也可以参考一下昨天的那个『搬家』案例,将多种运营方式结合起来,等一种方式稳定之后再逐步去上另一种方式,可能会好一点。