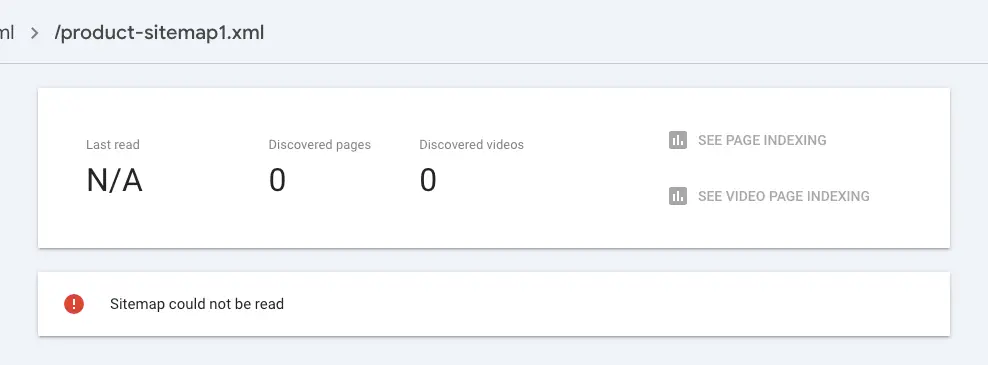

我最近有个网站在提交站点地图时碰到个比较棘手的问题,如下图。

这个网站是去年年底上线的,当时打算是过完年回来后再更新内容。

十多天前便开始处理内容更新,陆续有上传了大几十款产品信息,但是最近在检查收录内容时发现这些新上传的内容根本没被收录。

于是检查配置信息的时候,发现站点地图的这个问题。

前天我自己尝试着在站长工具后台,手动随机提交一条链接收录,今天再去检查这条链接时发现该链接已经被收录了。

这种情况至少说明网站的一些基础配置没什么问题,且我自己主动访问站点地图链接,基本都是没什么问题的。

所以最可能的问题点,就是站点地图的读取不流畅(爬虫日志上有显示相关的抓取记录),于是开始去论坛里面搜索这类情况近期是否有出现。

我发现论坛里有个帖子的情况与我现在这种情况比较类似,也是网站做好之后提交站点地图,显示读取不了内容,但后台日志能看到谷歌爬虫的抓取痕迹。

在帖子底下,我看到了 John Mueller 的回复,原文是这样的。

One part of sitemaps is that Google has to be keen on indexing more content from the site. If Google’s not convinced that there’s new & important content to index, it won’t use the sitemap.

表面的意思是搜索引擎得觉得这个网站的内容有质量,才可能会继续去读取站点地图,不然就直接略过。

那潜台词自然就涉及到网站质量相关问题了,也就是搜索爬虫第一次来的时候,觉得网站质量不行的话,就直接跳过不理会网站内容了。

回想我当时上线网站的操作,可能还真有这方面的影响。

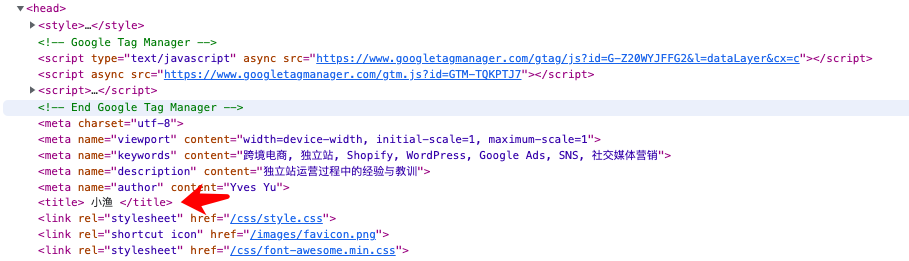

我的习惯是,先上线网站,等后面时间宽裕之后再来集中更新内容。

网站上线时,基本就一个空壳子,共计首页、联系我们,外加几个协议页面,此外便没什么信息了。

可能第一次爬虫来的时候,看到这样的布局与信息密度之后,就认为这样的网站没有意义,于是自然便不会花费资源去做更多信息的抓取了。

即便现在开始更新内容了,但是几周之前的“第一印象”已经形成了,短期内扭转的可能性不高。

后面持续更新下内容,并手动提交几个高密度信息页面给搜索引擎试试,到时再看看什么表现。